开云体育

DeepSeek-V3外网刷屏爆火训练成本只有开云体育600万把AI大佬都炸出来了

延续便宜大碗特点的基础之上,DeepSeek V3发布即完全开源,直接用了53页论文把训练细节和盘托出的那种。

我们整理了外网上对于DeepSeek V3的热议,综合了「量子位」和「新智元」的内容。

Coding 领域太卷了,海外一波又一波的融资,国内的创业公司和模型公司也在不断加码,最近 DeepSeek 甚至干到了国际领先水平。

12 月 27 日(今晚)8 点,Founder Park 直播间,和 AIGCode 的创始人 & CEO 宿文、豆包 MarsCode 产品负责人石扬一起,聊聊 AI Coding 为什么成了大模型落地最火的赛道?

直观地从钱上来对比就是,训练671B的DeepSeek V3的成本是557.6万美元(约合4070万人民币),而只是训练一个7B的Llama 2,就要花费76万美元(约合555万人民币)。

作为参考,要达到这种级别的能力,通常需要约1.6万个GPU的计算集群。不仅如此,当前业界正在部署的集群规模甚至已经达到了10万个GPU。

比如,Llama 3 405B消耗了3080万GPU小时,而看起来更强大的DeepSeek-V3却只用了280万GPU小时(计算量减少了约11倍)。到目前为止,模型在实际应用中的表现相当出色——不仅在LLM竞技场名列前茅,而且从Karpathy本人的快速测试来看,结果也都很不错。这说明,即便是在资源受限情况下,模型也能展现出令人印象深刻的研究和工程能力。

这是否意味着前沿LLM不需要大型GPU集群?不是的,但这表明,你必须确保不浪费已有的资源,这个案例很好地证明了在数据和算法方面还有很大的优化空间」。

Meta科学家田渊栋也惊叹DeepSeek V3的训练看上去是“黑科技”:

首先最重要的是,我们正式进入了分布式推理时代。一台单GPU机器(80×8=640G)的显存已经无法容纳所有参数。虽然更新大显存机器确实可以装下模型,但不论如何,都需要分布式推理来保证性能和未来扩展。

即使在单个模型中,也需要关注MoE的负载均衡,因为每次推理只有大约5%的参数激活。

论文中特别提到引入「redundantexpert」概念,正是为了解决这个问题。这已经不再是「一个模型多个副本」的问题、而是「每个模型子模块都有多个副本」,然后独立扩缩容。

每百万输入tokens 0.5元(缓存命中)/ 2元(缓存未命中),每百万输出tokens 8元

单论价格,正如一开始提到的,它几乎是Claude 3.5 Sonnet的1/53(后者每百万输入3美元、输出15美元)。

而如果要平衡性能和成本,它成了DeepSeek官方绘图中唯一闯进“最佳性价比”三角区的模型。

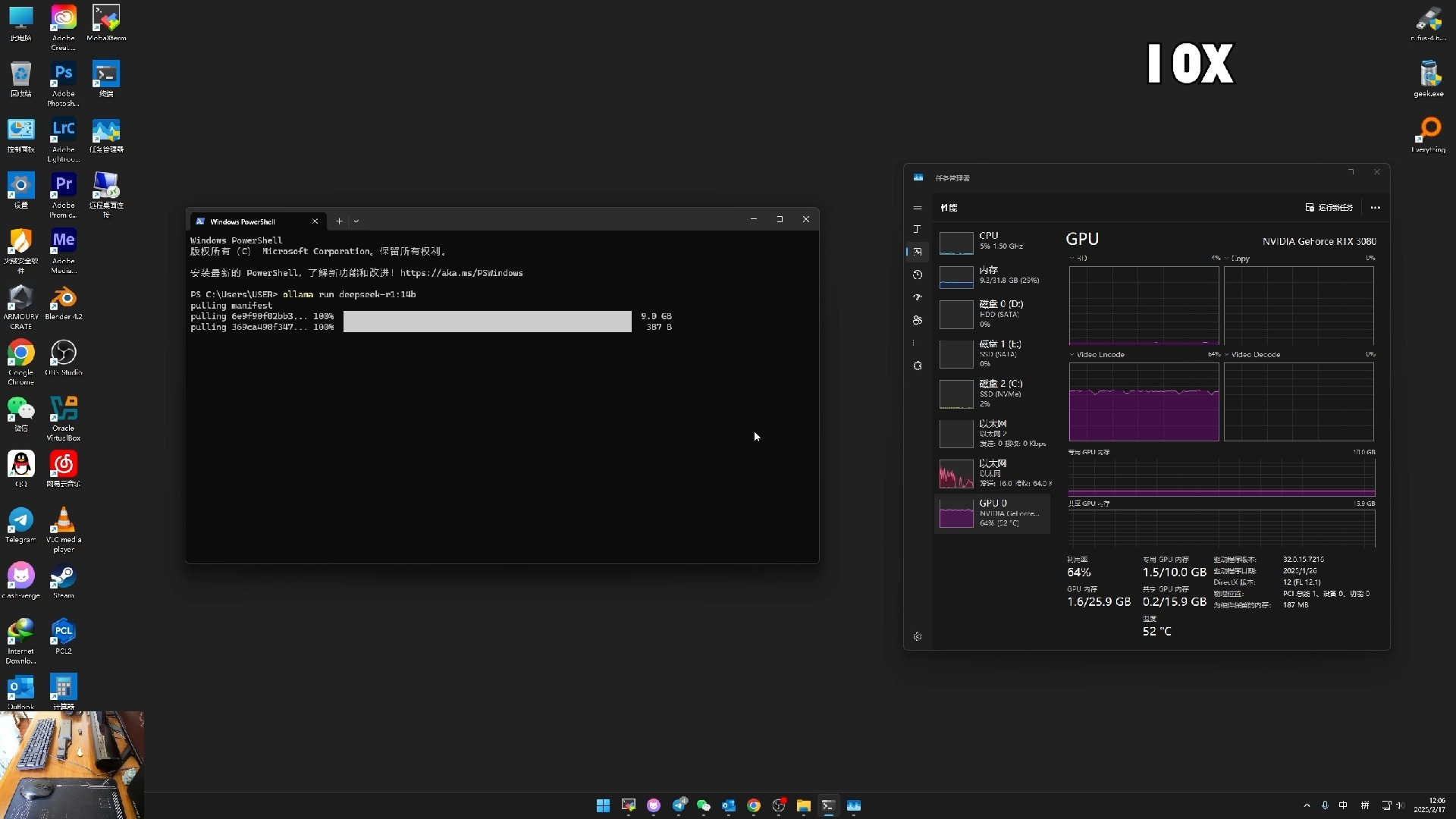

DeepSeek-V3现在已经在官方平台上直接可以测试,而且代码全部开源可以直接下载。

国外AI发烧友们纷纷开启了测试,有人直接将4/8个M4 Mac mini堆叠在一起来运行DeepSeek-V3了...

一位开发者惊讶地表示,DeepSeek-V3无需我解释就能如此准确地理解一切,这种感觉真让人毛骨悚然。就好像机器里真的住着一个幽灵似的。

另有开发者通过DeepSeek-V3创建了一个用AI公司logo制作的小行星游戏,分分钟就完成了。

Stability AI前CEO表示,以每秒60个token(相当于人类阅读速度5倍)的速度全天候运行DeepSeek v3,每天仅需要2美元。

官方介绍,通过在算法、框架和硬件方面的协同优化,DeepSeek V3的训练成本变得非常经济。

预训练阶段,在每万亿token上训练DeepSeek V3仅需要18万GPU小时,就是说,在官方2048卡集群上,3.7天就能完成这一训练过程。

研发团队用了不到2个月的时间就完成了DeepSeek V3的预训练,耗费了266.4万GPU小时,再加上上下文长度扩展的11.9万GPU小时,和后训练的5000 GPU小时,总训练成本为278.8万GPU小时。

假设GPU租赁价格为每GPU小时2美元,那成本换算过来就是557.6万美元。

首先,架构方面,DeepSeek V3采用了创新的负载均衡策略和训练目标。

研发团队在DeepSeek-V2架构的基础上,提出了一种无辅助损失的负载均衡策略,能最大限度减少负载均衡而导致的性能下降。

具体而言,该策略为MoE中的每个专家引入了一个偏置项(bias term),并将其添加到相应的亲和度分数中,以确定top-K路由。

研发团队还证明,多Token预测目标(Multi-Token Prediction,MTP)有利于提高模型性能,可以用于推理加速的推测解码。

预训练方面,DeepSeek V3采用FP8训练。研发团队设计了一个FP8混合精度训练框架,首次验证了FP8训练在极大规模模型上的可行性和有效性。

论文中还提到了跨节点MoE训练中的通信瓶颈问题。解决策略包括,设计DualPipe高效流水线并行算法:在单个前向和后向块对内,重叠计算和通信。

这种重叠能确保随着模型的进一步扩大,只要保持恒定的计算和通信比率,就仍然可以跨节点使用细粒度专家,实现接近于0的all-to-all通信开销。

后训练方面,DeepSeek V3引入了一种创新方法,将推理能力从长思维链模型(DeepSeek R1)中,蒸馏到标准模型上。这在显著提高推理性能的同时,保持了DeepSeek V3的输出风格和长度控制。

其他值得关注的细节还包括,DeepSeek V3的MoE由256个路由专家和1个共享专家组成。在256个路由专家中,每个token会激活8个专家,并确保每个token最多被发送到4个节点。

DeepSeek V3还引入了冗余专家(redundant experts)的部署策略,即复制高负载专家并冗余部署。这主要是为了在推理阶段,实现MoE不同专家之间的负载均衡。

可以看到,在各项基准测试中,DeepSeek V3在开源模型中达到SOTA。

2025-09-16

2025-09-16 浏览次数:

次

浏览次数:

次 返回列表

返回列表